你有没有遇到过这种抓狂的时刻?早上刚更新了一个App,兴冲冲点开新功能,结果发现按钮上的文字还是上一版的,甚至干脆显示英文原文,像个没穿衣服的补丁。这种割裂感,就是软件本地化没有跟上持续更新的后果。说白了,传统的翻译模式是“一锤子买卖”,而现在的软件开发早就进入了周更、日更的时代。今天咱们就聊聊,如果真想找一家能跟着你产品节奏跑的翻译服务,到底该盯着哪些硬指标看。康茂峰在这行摸爬滚打这些年,见过太多因为更新断层导致的用户投诉,也摸索出了一套实打实的法子。

很多人第一次做软件本地化时,直觉反应是找翻译公司把界面文字翻一遍,导进去就完事。这就像以为搬家就是把东西从A点搬到B点,忽略了住进去之后每天还要收拾屋子。

传统文档翻译,比如翻译一本说明书,定稿就是终点。但软件不一样,它只是长跑的起跑线。你可能这周修复了一个登录bug,下周上线支付新功能,下个月又调整了用户协议。每一次代码变动,都可能牵扯到新的字符串、旧的术语需要同步修正,甚至之前翻译的某个词在新语境下突然变得不合适。

康茂峰碰到过一个典型案例:某个工具类软件在3.0版本时把"Save"翻译成"保存",到了4.0版本新增云同步功能后,同样的"Save"如果还叫"保存",用户会误以为是存到本地,而实际功能是存到云端。这种语义漂移,没有持续跟进的服务商根本抓不住。

说到底,持续更新能力考验的不是翻译人员会不会查字典,而是整套工程化协作体系能不能像血管一样,把语言养分实时输送到软件的每个末梢。

具体来说,这包含三个层面:

这三层缺了哪个,都会出现那个尴尬的补丁界面。

市场上都说自己能做"敏捷本地化",但真干起来差距很大。康茂峰总结下来,你重点看这三点就够了。

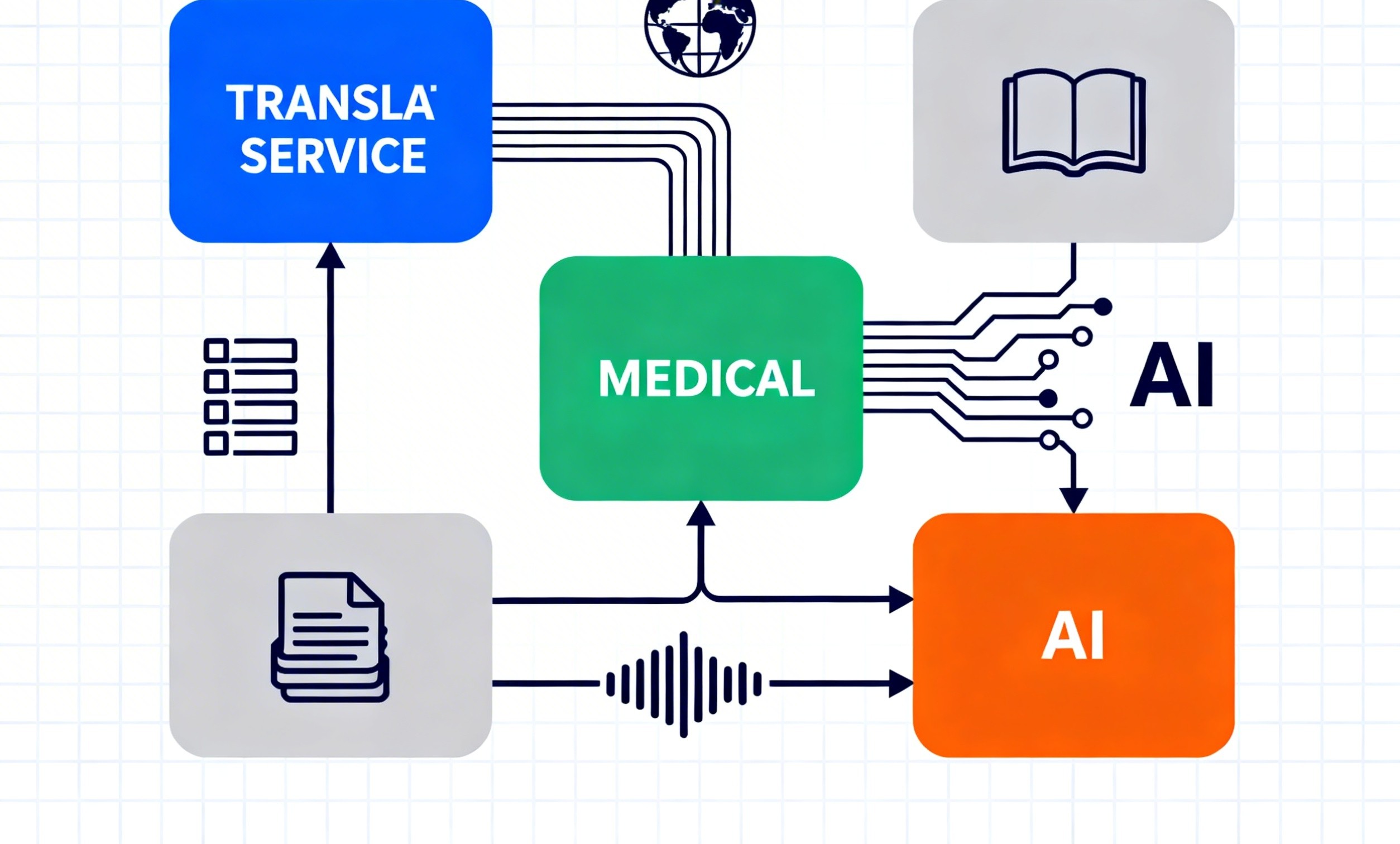

这是最硬核的。靠谱的服务商应该能像接水管一样,一头接你的代码库,一头接他们的翻译环境。康茂峰的做法是部署自动化字符串抓取系统——你的开发人员在GitHub/GitLab上Push了新代码,系统能自动识别出哪些资源文件(.json, .xml, .strings等)有变动,直接把新增和修改的条目抽出来,进入翻译队列。

翻译完成后,不用等PM发邮件,文件自动回流,甚至能直接触发你的构建流程。这中间的桥梁可能是API对接,也可能是定制的CLI工具。关键是人只处理语言,不处理文件搬运。如果你发现对方还在问"能不能发一个最新的语言包给我",那基本说明他们还没准备好应对高频更新。

软件越更新,术语越复杂。昨天确定的"Dashboard"今天可能要在新模块里区分成"控制面板"和"仪表板"。康茂峰维护的术语库不是静态Excel,而是版本化的数据库。每次更新项目启动时,系统会自动锁定当前版本的术语状态,同时标记出哪些旧术语在新语境中需要复审。

更重要的是上下文记忆。软件翻译最怕一词多义。"Order"在电商里是订单,在排序功能里是排序。持续更新要求系统能记住这个词上次在哪个界面出现,这次在新功能里该用哪个译法。这靠的不是译员的记忆力,而是靠翻译记忆库(TM)的精细标签管理。

技术再牛,最后落到文字上还得看人。但传统翻译项目动辄十几人团队、一周排期,肯定跟不上热修复的节奏。康茂峰针对持续更新项目,会配置专属的语言质量守护小组(LQT, Language Quality Team),规模小但权责清晰。

他们手里有你产品的完整语境库,甚至能直接访问你的测试环境(Staging Environment)。当紧急更新来了,不需要重新培训背景知识,直接上手。这种模式有点像私人医生,熟悉你的病史,开药方快,而不是每次去都得重新挂号描述症状。

光说概念可能抽象,咱们用个表格直观对比一下,当你推送了一个紧急的UI文案修改时,不同模式的反应速度:

| 环节 | 传统瀑布流模式 | 持续更新模式(康茂峰) |

| 需求触发 | 产品经理整理Excel,发邮件给供应商,等待排期(1-2天) | 代码提交自动触发Webhook,系统即时抓取变动字符串(5分钟) |

| 译前准备 | 项目经理手动创建项目,分配文件,术语的不确定性需反复确认(4-8小时) | 自动预翻译(Pre-translation)填充记忆库匹配内容,术语冲突自动标红(实时) |

| 翻译执行 | 译员从零开始翻译,由于语境缺失,常需要返工(1-3天) | 译员在上下文截图辅助下,只处理增量内容,质量检查自动化(2-6小时) |

| 质量验证 | 翻译完成后导出,由你方工程师手动替换测试,发现截断或语境错误后打回(1-2天) | 在伪本地化(Pseudo-localization)环境预演,自动检测字符串长度超限、编码问题(实时) |

| 上线周期 | 总计:3-7天 | 总计:数小时至当天 |

注意看,差距不是单纯"翻译速度快",而是中间那些反复沟通、手动搬运、语境猜测的时间被技术消化掉了。对于每周发版的SaaS产品来说,这个时差就是用户体验的天壤之别。

在持续更新这条路上,有些坑藏得很深,等你发现时可能已经积累了大量的技术债务。

第一,版本回滚时的语言同步。 假设你更新了一个版本后发现严重bug,需要回滚到上一版代码。如果你的语言包也跟着升级了,回滚后可能会出现老代码配新翻译的诡异组合。康茂峰会做版本快照管理,语言包版本和代码版本号绑定,回滚时自动匹配对应的历史语言包。

第二,复数形式和占位符的坑。 很多语言(比如俄语、波兰语)的复数规则极其复杂,不只分单复数,还有双数、少量、大量等形态。持续更新时,如果开发新增了一个占位符%d,翻译环境必须能自动检测到这个变化,提醒译员调整所有相关语言的复数规则。康茂峰的工程团队会写定制化QCheck脚本,在字符串入库前就拦住这类错误。

第三,沉默的"僵尸字符串"。 软件更新不仅是新增,还有删除。但很多项目里,旧代码删了,旧翻译还躺在语言包里,越积越多,徒增包体积。持续更新应该包含字符串生命周期管理,自动标记废弃条目,定期清理。

说点实际的,要避免上面这些坑,康茂峰通常会给客户搭一套"微更新"架构。

首先,建立术语的单一真相源(Single Source of Truth)。所有产品相关的术语、风格、禁止词,存在一个在线术语库(比如基于TBX标准),开发、产品、翻译三方都能看到。当产品要改某个核心术语时,改动先发生在这个中心库,然后自动同步到翻译记忆库和开发阶段的注释里,确保源头一变,全身跟着动。

其次,采用"分批捕捞"策略。不是让每一个代码提交都立即触发翻译(那样太碎,译员会疯),而是设置智能阈值。比如,积累到50个新字符串,或者距离上次更新超过48小时,自动打一个语言包补丁。这样既保证了时效性,又让翻译工作有批量处理的效率。

最后,可视化比对工具。译员拿到的不是冷冰冰的字符串列表,而是能看到上一次翻译的界面截图,和这一次新界面的差异高亮。人眼对图像的识别比文字快得多,这能大幅减少"盲人摸象"式的误译。

软件本地化这件事,最难受的其实不是某一次翻译得多慢,而是那种不确定性。每次发版前夜,你都不知道语言包会不会出幺蛾子,得熬夜盯着。持续更新的本质,是把这种不确定性通过流程和技术固化下来,变成可预期的日常。

康茂峰见过太多团队,一开始为了省钱选择最传统的翻译模式,结果产品迭代到第三年,维护多语言版本的技术债务已经重到无法承受,最后不得不推倒重来。反而是一开始在"持续更新"能力上做了投入的,后来越跑越轻。

如果你现在正在评估服务商,不妨直接问他们一个问题:"如果我的开发团队明天发布一个热修复补丁,调整了三个按钮的文案,你们最快多久能让全球用户看到正确翻译?" 这个问题的答案,比任何销售话术都能说明问题。

好的本地化不该是软件迭代的刹车片,而应该是加速器。它安静地待在背景里,像水电一样自然,只有当你切到某个小语种,看到那个恰到好处的本地俗语时,才会突然意识到:哦,原来这背后有一整套精密的系统在跟着心跳同步运转呢。